科技日报记者 金凤 通讯员 孙艳 吴涵玉

“一项政策的出台,将会影响哪些人,是否会造成对部分群体的不公?企业在进行商业决策、推广品牌时会不会有伦理风险?人工智能(AI)伦理大模型可以为这些问题提供答案。”12日,在东南大学“全球首个系统级伦理垂域大模型—‘问道’”的新闻发布会中,东南大学AI伦理实验室主任王珏对该模型作出如此描绘。

“问道”拥有伦理风险评估与审计、伦理困境模拟与决策推演、伦理对齐辅助设计、动态知识库与案例教学、伦理学前沿探索与范式革新等五大功能,目前免费向用户开放。

“‘问道’致力于成为用户的伦理思考伙伴与决策支持系统,试图帮助科研机构、科技企业、伦理审查机构、政策制定者以及公众在复杂的技术与社会问题中,洞察多元价值,守护共同善。”王珏说。

多场景应用从源头避免偏见和风险

“AI生成内容有没有著作权?”

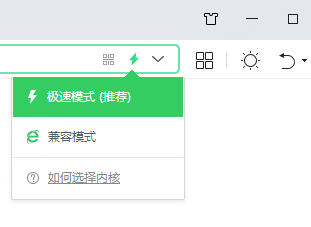

记者在“问道”大模型中输入上述问题,模型几秒钟便生成答案,其中包括结论摘要、背景原理、建议和信息来源类别说明。

与众不同的是,大模型在背景原理部分,援引了《中华人民共和国著作权法》的基本原则和《人工智能生成合成内容标识办法》。

“‘问道’的知识库不是全能的,但力求输出的内容是有理有据的。”王珏说。

“问道”由东南大学AI伦理实验室主任、人文学院教授王珏牵头设计,东南大学移动通信全国重点实验室、毫米波全国重点实验室、教育部移动信息通信与安全前沿科学中心以及江苏省道德发展智库等跨学科平台共同研发。

“问道”可以做什么?在团队设计的应用场景中,该模型可以作为企业伦理审查官,自动审核商业决策、广告文案、算法模型是否存在伦理风险;也可以作为AI研发的“合规检测工具”,在产品设计之初就注入伦理考量,从源头避免偏见和风险;还可以作为学生的伦理导师,通过模拟真实的道德困境,培养学生的批判性思维和道德决策能力。

“我们希望用AI的技术能力,去主动加速、强化人类社会的伦理建设,让‘道德进步’不再滞后于‘技术进步’,实现‘用技术解决技术带来的道德问题’。”王珏说。

五大功能覆盖伦理治理全流程

作为首个系统级伦理垂域大模型,“问道”构建了覆盖伦理治理全流程的功能矩阵。

王珏解释,在五大功能中,就伦理风险评估与审计而言,模型通过系统识别算法中的公平性、隐私与安全等隐患,实现伦理风险前置防控。

在伦理困境模拟与决策推演中,模型通过构建高拟真道德场景,辅助用户进行多视角推演与决策优化。

在伦理对齐辅助设计时,模型将价值观原则转化为可执行、可量化的工程技术标准与算法规范,为人工智能产品提供从理念嵌入到合规落地的全链路方案。

就动态知识库与案例教学来说,模型汇聚全球伦理规范与典型案例,支持智能检索和情境学习,提升专业知识的获取效率。

此外,模型致力于伦理学前沿探索与范式革新,通过深度文献挖掘与理论分析,协助学者洞察伦理发展规律,推动学术研究范式跨越升级。

“整体上,‘问道’能够对AI应用中的各类风险进行系统识别与评估,并从中国语境出发提出具有可操作性的治理路径。”王珏说。

将灌注的数据建成“知识树”减少大模型“幻觉”

随着AI的广泛应用,“AI幻觉”也随之产生。当AI“吸收”的原始数据不足、错误或本身带有偏见,都会让其生成错误的观点和事实。

“我们以结构与约束减少幻觉,以透明与追溯克服伦理‘黑箱’。”王珏说,“问道”并非依靠“大而多”的训练,而是依靠“结构化知识构建+多模式应答+分层安全机制+自动优化循环”四大体系形成的技术闭环。

该模型的技术开发人员、东南大学信息科学与工程学院博士研究生缪钰杰解释:“我们在通用大模型基座的基础上,为‘问道’灌注了经典的伦理学著作、我国具有重大意义的伦理学案件、涉及伦理学的法律法规,以及自动驾驶、生物基因等近年来社会热点事件中的伦理规范。”他说,团队以目录感知的方式输入数据,形成一棵“知识树”,从而在向用户输出信息时,可以让用户了解哪些内容来自哪本书的哪个章节。这种方式除了可以为用户提供结构化的知识图谱,还能降低大模型的“幻觉”。

王珏表示,未来,“问道”将持续优化人机交互机制,注重开发的系统性和渐次性,向专家和用户开放反馈通道,形成模型迭代的良性闭环,并进一步拓展其在科研、产业与教育等场景的深度应用,为推动人工智能与社会伦理协同发展贡献智慧。

网友评论

网友评论