科技日报记者 都芃

在日前举办的2025深圳全球招商大会人工智能与机器人主题活动现场,AI创业企业DreamTech正式发布了其新一代基础模型架构Neural4D-2.5。该模型实现从底层算法到终端应用的全栈重构,突破了困扰3D AIGC(人工智能生成内容)领域已久的贴图与实物制造难题。

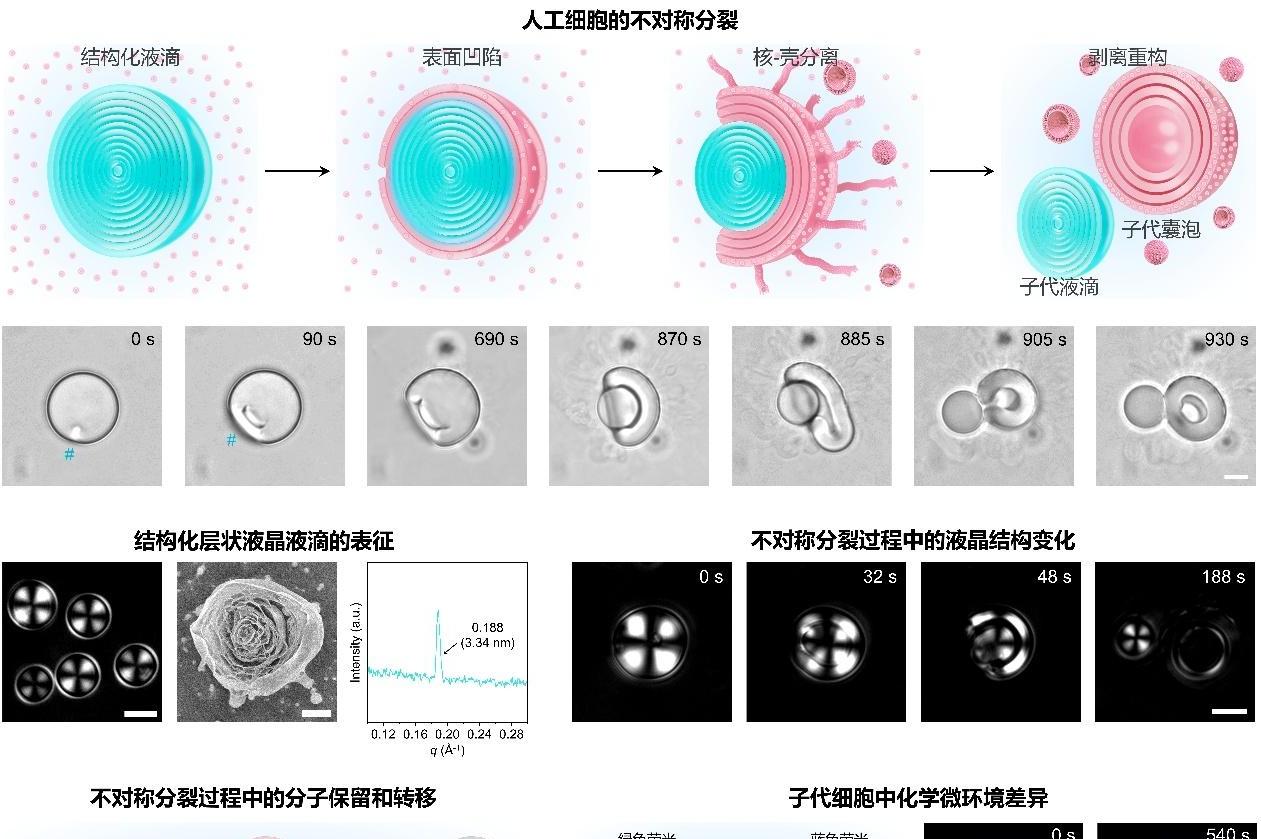

在纹理贴图上,不同于行业常用的“先建白模再投影贴图”的分离式做法,Neural4D-2.5在生成瞬间便可实现几何结构、纹理色彩与物理属性在三维空间中的同步“生长”。这种“感生一体”的设计,从根源上消除了传统模型常见的贴图错位和光影死板问题。

在算力昂贵的今天,国内外AI巨头训练同类3D大模型通常需要数千张GPU(图形处理器),耗时数周,单次训练成本超百万美元。Neural4D-2.5的训练成本仅为行业的1/30,推理成本仅为1/20。更低的成本,带来的是更强的性能。评测数据显示,Neural4D-2.5的整体性能领先,针对复杂场景的生成成功率更是较上一代提高200%。

在3D AIGC领域,最难的生成对象往往不是写实物体,而是那些看似“不讲道理”的图片——比如一张夸张的表情包,或者飘逸的魔法特效,常规算法通常对此束手无策。

作为首个突破100万Tokens(词元)上下文的3D生成模型,Neural4D-2.5不再只是“看图猜形状”,而是能够深度解析并构造复杂的拓扑结构。无论是悬浮的粒子、飘散的头发,还是抽象的写意画甚至表情包,都能被模型精准捕捉并构建。

针对3D AIGC纹理贴图中常见的纹理质量问题,Neural4D-2.5对色彩解码器进行了针对性优化,重点解决了高频杂色与颜色溢出两大痛点,通过优化解码算法,显著减少了纹理中的伪影和噪点,使模型表面更加干净、通透;增强了模型对不同材质和颜色区域的界定能力,确保色彩边界清晰,互不干扰。

相比上一代,Neural4D-2.5生成的贴图质量显著提升,减少了后续人工修图的工作量,更加接近“开箱即用”的标准。

(受访单位供图)

网友评论

网友评论