科技日报记者 刘霞

英国《自然》网站在6日的报道中指出,建造实用量子计算机的竞赛正迈入新阶段。此前领先的一些技术,如超导量子比特等目前正面临扩大规模方面的限制,而其他“小众”技术正迅速迎头赶上。目前量子计算技术路线已呈现“百花齐放”态势,超导、离子阱、中性原子等竞相“争奇斗艳”,不过最终“花落谁家”仍是未知数。

叠加是秘密武器

量子比特相比传统计算机比特更强大,是由于两个独特的量子现象:叠加和纠缠。叠加使量子比特能够同时为0和1,而传统比特只能为0或1。因为量子叠加态中同时存在多种状态,所以可同时处理多种计算。

不过,为尽可能长时间地保持量子态,量子比特必须与周围环境隔离开。但又不能过于孤立,因为它们必须相互作用才能执行计算。

荷兰量子技术研究机构QuTech的研究总监伊文·万德斯芬表示,这就使建造一台实用量子计算机极具挑战性,尽管如此,该领域最近10年取得的进展“令人印象深刻”。

超导“一马当先”

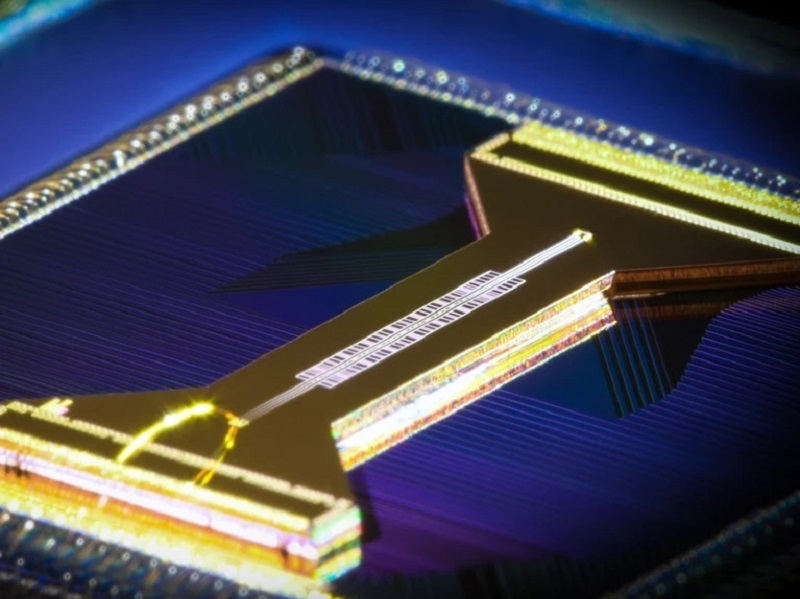

谷歌的量子计算硬件 图片来源:《自然》网站

在多种量子技术发展路线中,超导量子比特“一马当先”。2019年,谷歌宣布开发出54个量子比特的超导量子芯片,其对一个电路采样一百万次只需200秒,而当时运算能力最强的超级计算机“顶点”需要一万年,率先实现了“量子优越性”。

在这一领域,IBM公司去年11月宣布推出包含433个量子比特的量子芯片“鱼鹰”,预计未来几个月,该公司将推出首款拥有1000个量子比特的量子芯片“秃鹰”。

不过,科学家也指出,一旦芯片上超导量子比特的数量远远超过1000个,扩大规模就变得非常困难,因为每个量子比特都需要与外部电路相连以便进行控制。因此,IBM计划采用模块化方法,从2024年起将不再执着于增加芯片上量子比特的数量,而是将多个芯片连接到一台机器上。

IBM公司的量子计算系统 图片来源:《自然》网站

离子阱“不甘示弱”

霍尼韦尔量子计算机的离子阱 图片来源:《自然》网站

离子阱技术路线由于量子比特相干时间长、量子比特之间的连接性好、逻辑门操作保真度高等特点备受业界关注,现已成为通用量子计算机发展中的领先路线之一。

但离子阱量子计算机更难扩展,部分原因在于需要单独的激光设备来控制每个离子。美国初创公司IonQ开发出的方法能将多行离子封装到一个芯片内,量子比特的数量可能多达1024个。

IonQ也计划采用模块化方法连接多个芯片,实验表明其离子阱量子比特的置信度高达99.99%。

中性原子“驶入快车道”

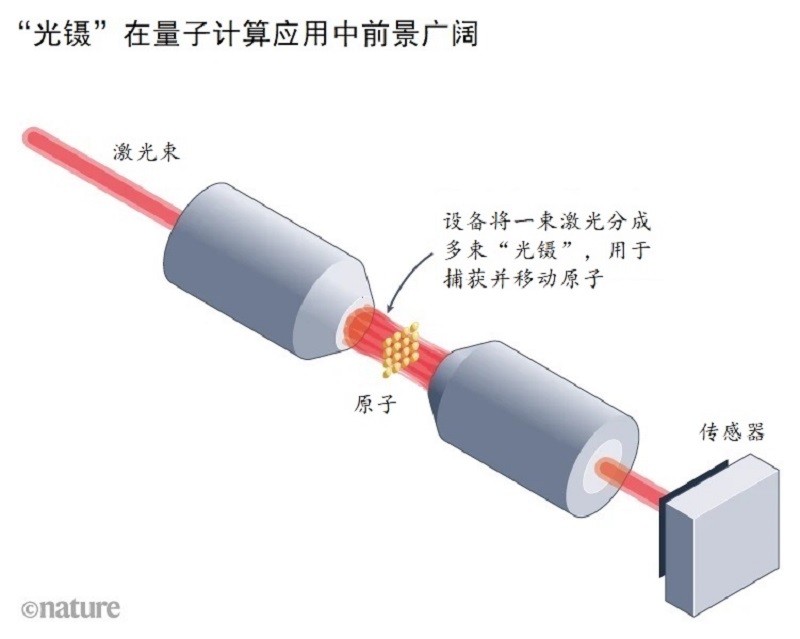

光镊技术演示图 图片来源:《自然》网站

另一种技术可能会突破1000个量子比特。该技术使用聚焦的激光束(光镊)捕获中性原子,并用原子的电子态或原子核的自旋编码量子比特。这种方法已发展了十多年,现在正“驶入快车道”。

研究人员已利用光镊建立了由200多个中性原子组成的阵列,他们正迅速将新技术和现有技术结合,以用于实用量子计算机的研制过程。

这项技术的一个主要优点是,可让多种类型的光镊与其携带的原子相结合。这就使该技术比超导等其他平台更灵活。在超导回路内,每个量子比特只能与芯片上的“近邻”相互作用。

这种方法获得的量子比特的置信度很快将达到99%,但进一步提升仍需大量研究。

硅自旋电子等“迎头赶上”

其他量子比特技术尽管仍处于起步阶段。

一种方法是利用被硅等传统半导体内部电场捕获的单个电子的自旋作为量子比特编码信息。去年9月,QuTech团队在《自然》杂志上发表论文称,他们设计并实现了创纪录的6个硅基自旋量子比特处理器,能以较低误差率运行,有助于实现基于硅的可扩展量子计算。尽管该技术能与先进的半导体制造技术兼容,但与超导等平台相比,硅自旋量子比特的规模目前还很落后,该领域的主要挑战和重要方向在于扩大量子比特数量的同时实现所有组件的高保真度。

还处于概念阶段的拓扑量子比特已获得大量投资。理论上,拓扑量子比特比传统量子比特具有更低的错误率,因此能以更低的费用实现可扩展量子计算。微软公司现在正致力于演示第一个拓扑量子比特。

研究人员指出,这些计算平台都有希望,但最终开发出实用型量子计算机可能还需更具创新性的想法。