科技日报记者 崔爽

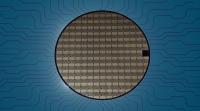

物理世界的信息由图像、声音、文字交织而成,但通往真正物理世界智能的边界,绝不仅仅是语言。近日,美团发布并全面开源原生多模态大模型LongCat-Next及其核心组件——离散原生分辨率视觉分词器(dNaViT)。

据介绍,今天的主流多模态大模型,本质上仍是“语言基座+外挂视觉/语音模块”的拼凑系统。非语言模态往往只作为辅助组件被“投影”到语言空间,导致图像的理解(依赖对齐机制)与生成(依赖扩散模型)在结构与优化上长期割裂。

能否让AI像处理语言一样,用同一种方式简洁有效地处理物理世界的多种信息?

美团LongCat团队给出肯定的答案:通过构建DiNA(Discrete Native Autoregressive)离散原生自回归架构,LongCat-Next将所有模态统一为离散Token,并共享同一个自回归骨干。无论输入的是文字、图像还是音频,模型都使用同一套参数、同一个注意力机制和同一个损失函数。

在这一极简架构下,视觉的“看”与“画”、听觉的“听”与“说”,不再是异构模块的拼接,而是同一套预测逻辑的自然涌现。

值得一提的是,为了让物理世界的信号真正转化为AI的“母语”,LongCat-Next实现了三项关键技术突破:离散原生自回归架构(DiNA)彻底打破模态隔阂,离散原生分辨率视觉分词器(dNaViT)构造视觉世界的“词典”,语义对齐完备编码器破解“离散化必然损失信息”的行业难题。

“作为一个初步尝试,我们展示了一个有意义的视角:物理世界的信息可以被离散化、统一化、像语言一样被建模,让AI第一次能够像处理文字一样原生地理解物理世界的多模态信号。”美团LongCat团队相关负责人表示,“我们期待,有一天AI能真正‘看懂’物理世界的每一个角落、‘听懂’顾客的每一句话、理解物理世界的每一条规律。”

网友评论

网友评论